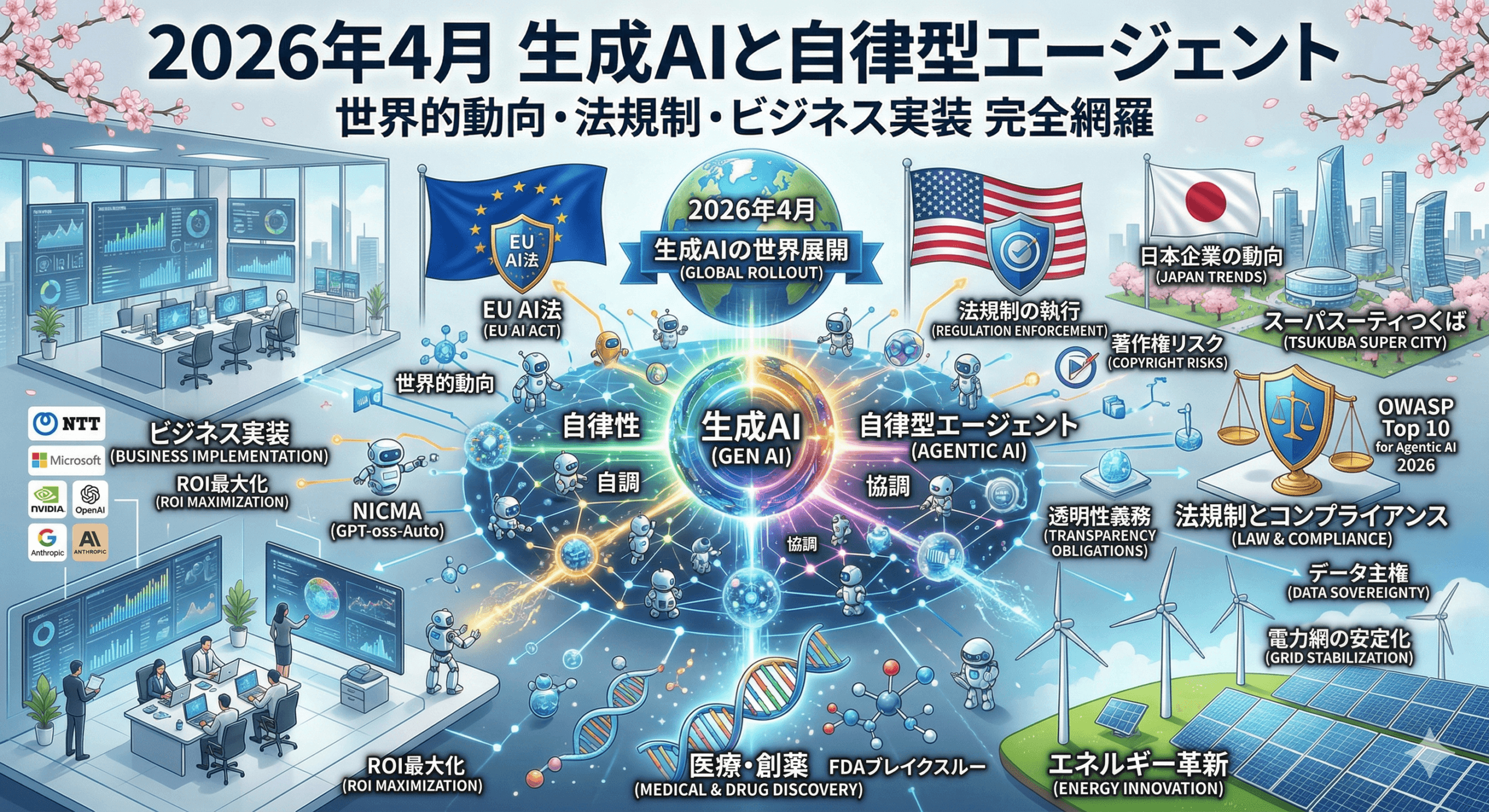

- 1. はじめに:生成AIの世界的進化と、今企業が直面している「本当の課題」

- 2. 基礎知識:2026年春・世界の主要フロンティアAIモデル動向

- 3. 最新トレンド:エージェンティックAI(Agentic AI)の爆発的普及

- 4. 国内動向:日本企業における生成AIとエージェントの実装トレンド

- 5. 産学連携:産総研・筑波大学が牽引する日本のAI研究エコシステム

- 6. リスクと対策:自律型AI特有のセキュリティ脅威

- 7. 法規制とコンプライアンス:EU AI法と世界のルールメイキング

- 8. 著作権リスク:AIと知的財産を巡る2026年の訴訟動向

- 9. 科学的ブレイクスルーとMicrosoftの「2026年 AIトレンド7選」

- 10. 実践的FAQ:生成AI導入・運用に関するよくある質問

- まとめ:2026年以降を生き抜くためのアクションプラン

1. はじめに:生成AIの世界的進化と、今企業が直面している「本当の課題」

2026年春、AI市場は「実験」から「超・実用」のフェーズへ

皆さん、日々の業務でAIをどのくらい活用していますか?2026年4月現在、生成AIを取り巻く環境は、単なる技術的な実験や概念実証(PoC)のフェーズを完全に脱却しました。今はもう、実社会における具体的な価値創出とシステム統合のフェーズへと本格的に移行しています 。

しかし、技術の進化速度は依然として指数関数的です。「どのモデルを使うべきか?」と悩んでいる間に、企業は「無数に存在するAIエージェントをいかに統制し、既存の業務フローやセキュリティと統合するか」という、さらに高度な課題に直面するようになりました。特に2026年3月から4月にかけては、複数の強力なAIモデルの同時リリース、自律型AIのインフラ標準化、欧米の法規制の執行開始など、市場構造を揺るがす大きな変化が連鎖的に起きています 。

情報過多と「シャドーAI」がもたらす現場の混乱

ニュースでは「AIによる劇的な業務効率化」が連日謳われますが、一方で著作権侵害の集団訴訟や、AIの自律性が引き起こす未知のセキュリティ事故など、負の側面も絶えず報じられています 。断片的な情報に翻弄され、従業員が未承認のAIツールを業務で使う「シャドーAI」が蔓延し、データ漏洩などの致命的なリスクを抱え込む企業が急増しているのが現状です 。

本記事でお伝えすること

この記事では、表層的なモデルの比較にとどまらず、技術、インフラ、セキュリティ、法規制という多角的な視点から「2026年現在のAIの真の現在地」を徹底解剖します。最新データの裏にある文脈を深掘りし、皆さんの組織における「次世代AI戦略」の強固な羅針盤となる情報をお届けします。

2. 基礎知識:2026年春・世界の主要フロンティアAIモデル動向

実は、2026年3月はわずか23日間に5つものフロンティアモデルが連続でリリースされるという、歴史的な1ヶ月となりました。各社の能力差(Capability gap)が劇的に縮小する中、主要モデルの特徴を見ていきましょう 。

OpenAI「GPT-5.4」シリーズの展開とSoraの終焉

OpenAIがリリースした「GPT-5.4」シリーズは、コストや用途に応じた3つのバリエーション(Standard、Thinking、Pro)を展開しています 。

Standard: 高ボリュームの処理とコスト効率に特化。

Thinking: 複雑な数学的推論やコーディングにおいて、思考過程を可視化。

Pro: 極めて高い信頼性を要求されるエンタープライズのワークフロー向け 。

GPT-5.4は巨大なエコシステムを持つ最高クラスの万能モデルとしての地位を確固たるものにしています 。一方で、市場に衝撃を与えた動画生成AI「Sora」は、高品質動画の生成にかかる計算コストが「経済的に到底見合わない(economically irreconcilable)」として、2026年3月末をもってパブリックAPIの提供を終了しました 。この決断は、AI業界全体に「計算資源の持続可能性」という現実を突きつけました。

Google「Gemini 3.1」とAnthropic「Claude 4.6」の躍進

Google Gemini 3.1 Ultra / Pro: テキスト、画像、音声、動画を単一の「200万トークン」という広大なコンテキストウィンドウで処理できるネイティブ・マルチモーダル推論を完成させました。また、モデル自身がサンドボックス環境でコードを実行・テストできるツールを標準搭載し、推論能力で業界をリードしています 。

Anthropic Claude 4.6 (Opus/Sonnet): 最も自然な文章生成能力とトップクラスのコーディング能力を誇ります 。特にコンピュータ操作などのエージェントタスクにおけるエラー率を従来比で40%削減し、コストを抑えるバッチAPIも導入されたことで、エンタープライズでの採用が急加速しています 。

Grok 4.20の実力とMistral Small 4が牽引するオープンソース

Grok 4.20 (xAI): X(旧Twitter)のリアルタイムデータと深く統合され、時事問題のファクトチェックにおいて圧倒的な精度を誇ります 。

Mistral Small 4 (Mistral AI): わずか220億(22B)パラメータの極めて軽量なオープンソースモデル(Apache 2.0)でありながら、大規模なクローズドモデルを凌駕する性能を見せています 。ローカル環境で稼働できるため、データプライバシーを重視する企業から絶大な支持を集めています 。

3. 最新トレンド:エージェンティックAI(Agentic AI)の爆発的普及

プロンプト入力から「マルチエージェント・ワークフロー」への不可逆な移行

2026年最大のパラダイムシフトは、人間が一度の指示で回答を得るスタイルから、AIが自律的にタスクを遂行するスタイルへの移行です 。もはやAIは単なる回答機ではなく、複数のAIエージェントが協調して計画立案、ツールの呼び出し、検証を行う「マルチエージェント・ワークフロー」へと進化しました 。人間はプロンプトエンジニアから「エージェントの管理者(Managers of Agents)」へと役割を変える必要があります 。

MCP(Model Context Protocol)の累計インストールが9,700万回突破

AIモデルと外部ツールを安全に接続するインフラ技術「MCP」は、2026年3月時点で累計9,700万回のインストールを突破しました。主要プロバイダーのほぼすべてがMCP互換ツールを出荷しており、企業内のERPやCRMといった実務データとAIをシームレスに結合するインターフェース競争が本格化しています 。

NVIDIA GTC 2026で示された企業向けエージェント基盤

NVIDIAは、管理されたビジネス環境でマルチエージェントシステムを編成するフレームワーク「NeMoCLAW」と、オープンソース版の「OpenCLAW」を発表しました 。明確なアクセス制御と人間による承認(Human-in-the-loop)を根幹に組み込むことで、「自律的システムは制御を失う」という懸念を見事に払拭しています。

4. 国内動向:日本企業における生成AIとエージェントの実装トレンド

NTTインテグレーション「GPT-oss-Auto」がもたらす実務革新

日本国内の実装も新たな次元に突入しています。注目すべきは、NTTインテグレーションが2026年4月1日に提供を開始した生成AIクライアントアプリ「NICMA」向けの最新モデル『GPT-oss-Auto』です 。 このモデルは、日本企業の「コストの不確実性」と「セキュリティの壁」を同時に解決します。

追加費用なし: 定額料金に含まれ、制限超過後も追加料金なしで利用を継続できます 。

国内閉域環境: 自社インフラ環境でホスティングされ、LGWANや専用線接続にも対応。最高レベルの機密性を担保します 。

推論の自動最適化 (Auto機能): プロンプトの難易度に基づき、AIが「処理速度」と「回答精度」の最適なバランスを自動選択します 。

運用設計力と標準化が勝負の分かれ目

国内市場は、AIを単一の部門で使うフェーズから、「全社横断で標準化して展開する」フェーズへ完全に移行しました 。勝負はモデルの性能差よりも、「AIが人間の意思決定をどこまで前倒しできるか」というKPI設計にかかっています 。AI・人工知能EXPO 2026春でも、コールセンター無人化など特定の業務フローに深く組み込まれたソリューションが展示の中心となっています 。

5. 産学連携:産総研・筑波大学が牽引する日本のAI研究エコシステム

産総研による新世代半導体コンソーシアムと製造業向けAI

国立研究開発法人産業技術総合研究所(産総研)は、2026年2月に「新世代半導体集積システム技術コンソーシアム(ASiST)」を設立しました 。また、同年3月には、製造業向けサーボシステムのパラメーター調整回数を従来比で90%削減し、タクトタイムを20%短縮する革新的なAI技術を発表し、製造現場の直近の課題を解決しています 。

筑波大学「DHI棟」とスーパーシティつくばの実証実験

筑波大学は、ワシントン大学などと連携し、10年間で約75億円規模となる国際共同プロジェクトを始動させています 。2026年12月竣工予定の「デジタルヒューマンイノベーション(DHI)棟」を中核に、AIオープンイノベーション拠点を構築中です 。 さらに、つくば市では都市全体をテストベッドとし、以下のような実証実験が進行しています 。

遠隔医療アプリを活用した小児オンラインかかりつけ医体制の構築

ドローンを活用した検体搬送サービスの地上リスク評価

装着型サイボーグ技術を利用した病院外でのリハビリテーション実証

6. リスクと対策:自律型AI特有のセキュリティ脅威

「OWASP Top 10 for Agentic AI 2026」が警告する新たな脅威

エージェントの導入は計り知れないメリットをもたらす一方、自律的な実行権限を与えることによる重大なリスクを伴います。国際的非営利団体OWASPは、自律型AI特有のリスク・トップ10を発表しました 。特に注意すべきは以下の3つです 。

ASI01 (目標ハイジャック): 悪意のある指示を注入し、エージェントの目的を乗っ取る攻撃 。

ASI02 (ツールの悪用と搾取): 曖昧な指示を介して、正規のAPIなどを危険な方法で連鎖的に悪用させる攻撃 。

ASI08 (カスケード障害): 単一の誤作動が他のエージェントへ連鎖し、システム全体をダウンさせるマルチエージェント特有のリスク 。

Exabeamなどの最新ソリューションによる防衛策

これらの脅威に対しては、AIエージェントの振る舞いを常時監視するガードレールが必須です 。サイバーセキュリティ企業のExabeamは、APIリクエスト量やトークン消費などの動的プロファイルを構築し、エージェントが確立された規範から逸脱した場合に即座に異常を検知・遮断するソリューションを展開しています 。Microsoft Copilot Studioなどでも実践的な軽減策の組み込みが進んでおり、AIエージェントの「アイデンティティ管理(IAM)」を厳密に行う体制が不可欠です 。

7. 法規制とコンプライアンス:EU AI法と世界のルールメイキング

2026年8月に迫るEU AI法の透明性義務

2026年は世界のAIガバナンスが「ルールの厳格な執行」へとフェーズ移行する決定的な年です。EUの「包括的AI法」は、2026年8月2日にAI生成コンテンツに対する透明性義務(第50条)などの本格施行を迎えます 。 企業は直ちに以下の対応プロセスを実装しなければなりません 。

AIとの相互作用の明示(チャットボット利用時の通知など)

生成コンテンツ(テキスト、画像等)の機械可読なラベル付け

ディープフェイクの厳格な開示

賛否両論を呼ぶ「デジタル・オムニバス法案」による「宙吊り状態」

一方で、欧州委員会は企業のコンプライアンス負担を削減するための「デジタル・オムニバス法案」を発表しました 。しかし、この規制緩和案は激しい議論を呼んでおり、高リスクAIプロバイダーにとっては、どの規制がいつ適用されるのかという法的要件が確定しない「宙吊り(Limbo)」の状態が続いています。 日本国内ではソフトローに基づく自主規制が推進されていますが(AI関連技術の研究開発・利活用推進法など)、EU AI法の域外適用リスクが高いため、グローバルスタンダードとしての準備が必須です 。

8. 著作権リスク:AIと知的財産を巡る2026年の訴訟動向

AIの学習用データ(Training Data)の適法性を巡る集団訴訟が、2026年に入り重大な局面に達しています。

出版・テキスト分野: 『Bartz v. Anthropic』や『Kadrey v. Meta』などの著名な作家による集団訴訟が、クラス認証(集団訴訟としての要件認定)を獲得するための激しい法廷闘争の段階に進んでいます 。

音楽分野: 大手音楽出版社による『BMG v. Anthropic』や、音楽生成AIに対する『Sony v. Udio』など、音源や歌詞の無断学習に対する責任追及が波紋を広げています 。

争点は「フェアユース」の境界線ですが、裁判所の判断はAI企業側の広範な防御を次第に切り崩しつつあります 。これに対し、一般企業(Deployers)は、IP保護に関する補償条項(Indemnification)の確認や、コンテンツ生成プロセスに人間の監視を介在させた証拠を残すガバナンス体制を整備することが不可欠です 。

9. 科学的ブレイクスルーとMicrosoftの「2026年 AIトレンド7選」

医療AIとエネルギー分野への応用

医療分野では、FDAからブレイクスルーデバイス指定を受けたNoah Labsの「Vox」のように、患者のわずかな音声から心不全の悪化を検知する予兆検知が実用化されています 。また、ミシガン州立大学による創薬プロセスの劇的短縮など、AIは科学研究の中核となっています 。さらに、AIの莫大な電力需要が逆説的にクリーンエネルギー(再生可能エネルギーや蓄電池)への移行を加速させている点も見逃せません 。

Microsoftが予測する2026年の7つのトレンド

Microsoftは、2026年を「AIがツールからパートナーへと進化する決定的な年」として、以下の7つのトレンドを挙げています 。

協働成果の増幅: 小規模チームがエージェントと協働し、劇的な成果を上げる。

セーフガードの確立: 労働力となるAIに対する新たなセキュリティの標準化。

医療格差の縮小: グローバルなヘルスケアへのアクセス改善。

研究プロセスの中核化: AIが真のラボアシスタントとなる。

コードと文脈の理解: ソフトウェア開発における背後の文脈(Context)の深い理解。

インフラのスマート化: ワークロードの動的ルーティングによる劇的な効率向上。

次世代計算への飛躍: 量子コンピューティングとのハイブリッドアプローチの進化。

10. 実践的FAQ:生成AI導入・運用に関するよくある質問

Q1: クローズドモデルとオープンソースモデルはどう使い分けるべき? A: コア業務には強力な推論力を持つクローズドモデル(GPT-5.4やGemini 3.1等)を、機密性が高い領域にはオープンソースモデル(Mistral Small 4等)を自社環境で運用する「ハイブリッド戦略」が最適です 。

Q2: AIエージェント導入時のセキュリティ上の最優先事項は? A: 人間の従業員と同様に、AIに対する厳密な「アイデンティティとアクセス管理(IAM)」を適用し、OWASP Top 10のリスク(特にASI01:目標ハイジャック)に対応した常時監視体制(Exabeam等の活用)を敷くことです 。

Q3: 日本企業はEU AI法にどう備えるべき? A: EU市民のデータを扱う日本企業は、2026年8月施行の透明性義務(AI生成コンテンツのラベル付け等)に直ちに対応できるガバナンス体制を構築すべきです 。デジタルオムニバス法案による規制緩和の議論はありますが、透明性確保は最低ラインとして揺るぎません 。

まとめ:2026年以降を生き抜くためのアクションプラン

この記事を通じて明らかになったように、生成AIは今や実社会の自律的なワークフローの中核へと浸透しています。企業が生き抜くためには、以下の3ステップが重要です。

ゼロトラストに基づくAIガバナンスの再構築: プロンプトインジェクション等に対するガードレールの導入や、EU AI法・著作権リスクに対応した透明性の確保を急ぐ 。

業務プロセスの根本的な再設計: AIを単なる省力化ツールと捉えず、「マルチエージェント」を前提としたワークフロー全体の標準化と、従業員のリスキリングを行う 。

人間中心のAI実装: AIは人間の創造力や共感力を極限まで増幅させる「最強のパートナー」です 。最終的な価値判断は人間が担うという哲学を貫くことが、持続的な成長への確実な道標となります。

皆さんの企業でも、本記事の内容を参考に、次世代のAI戦略をぜひ見直してみてください!